Данные есть. Рабочих данных — нет

Формально данные есть: открытые датасеты (например, ImageNet, MS COCO), уличные сцены (Cityscapes), большие веб-корпуса (Common Crawl), наборы с Kaggle или Hugging Face, академические выборки (UCI Machine Learning Repository), текстовые корпуса (Stack Exchange, научные архивы, open source репозитории).

Если смотреть на рынок со стороны, кажется, что проблема обучения ИИ давно решена: бери публичный датасет, немного дообучай модель и внедряй в бизнес.

Отсюда и распространенное ожидание, что для запуска системы достаточно собрать одну-две тысячи фотографий под конкретную задачу. Но это слишком мало. Это капля в море.

На практике всё сложнее. Открытые датасеты — это лишь верхушка айсберга. Модель обучается на разнородных изображениях, они показывают обобщенную картину: разные города, разные объекты, разные условия съемки. Но нередко работать приходится в узкой среде: на определенном складе, в конкретном цехе, который живет по своим визуальным правилам.

В итоге модель сталкивается с изображениями, которые отличаются от той статистики, на которой она обучалась. Для человека эта разница может быть почти незаметной, для нейросети это уже другие входные данные.

Приведу пример из практики: контроль нахождения сотрудников в зоне повышенной опасности рядом с оборудованием. Модель обучена на архиве видеозаписей объекта.

Через несколько месяцев на площадке меняют тип освещения. Камеры остаются теми же, логика бизнес-процесса не меняется, разметка корректна. Изменился только свет. Модель стала чаще путать человека с фоном и давать ложные срабатывания.

Причина в том, что компьютерное зрение не «понимает» сцены в человеческом смысле. Модель работает с извлеченными признаками: текстурами, границами, цветовыми распределениями, статистикой пикселей. Если в обучающей выборке недостаточно вариативности по освещению, ракурсу или контрасту, модель формирует устойчивые, но частично случайные корреляции. Пока среда соответствует обучающим данным, система работает стабильно. Как только условия меняются, эти корреляции перестают быть валидными.

Модель видит только 2D-проекцию сцены. У нее нет контекста, нет рефлексии и понимания среды. Даже при использовании 3D-данных она оперирует признаками, а не смыслом.

Пример: представим задачу детекции дорожного знака «Пешеходный переход». Модель обучена на датасете, собранном днем: четкий контраст, естественный свет. В этих условиях система корректно выделяет знак и обводит его рамкой. Но с наступлением вечера меняется освещенность, появляются отражения от мокрого асфальта, усиливается шум матрицы камеры, смещается цветовая температура. В этих условиях точность падает — растет число пропусков, и система перестает стабильно фиксировать знак.

Когда систему «ломает» не алгоритм, а среда

То, что произошло со знаком или с освещением в цехе, — это не исключение. Это закономерность. В промышленной среде такие сдвиги происходят постоянно. Причем систему редко «ломает» что-то глобальное, гораздо чаще — инженерные мелочи:

- камеру немного сместили при обслуживании;

- заменили освещение;

- обновили прошивку, изменилась цветокоррекция;

- установили защитное стекло, появились дополнительные блики.

Для человека сцена остается прежней. Для модели меняется распределение пикселей. Отдельный тип проблем — изменение самого визуального класса.

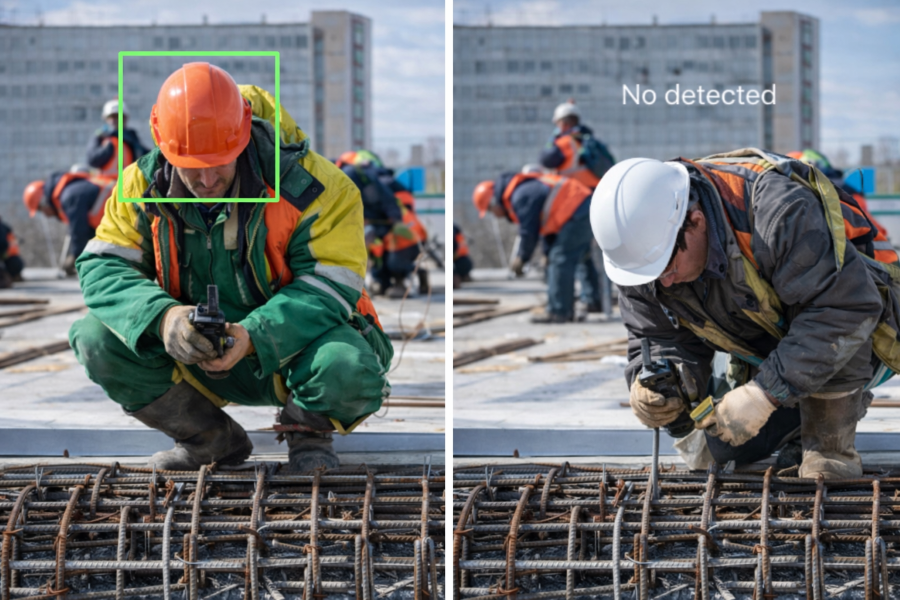

Например, система контроля средств индивидуальной защиты на стройке. Детектор обучен распознавать каски определенного цвета и формы. Через несколько месяцев поставщик меняется — каски становятся другого оттенка и профиля.

Формально задача та же. Фактически — другой визуальный класс. В результате приходится доснимать данные, проводить новую разметку и дообучать модель.

Сколько стоит «нормальный» датасет

Почему просто не собрать больше данных? Потому что полноценный датасет — это дорого.

Если говорить о задаче детекции пожара, то базовый набор данных начинается примерно от 500 тысяч рублей. При требованиях к высокой надежности бюджет может расти практически без ограничения. Для более простых задач — например, детекции одного типа объекта в стабильной среде — диапазон обычно составляет около 150–200 тысяч рублей. Но и там многое зависит от условий эксплуатации и частоты обновления данных.

Почему без ограничения? Потому что нужно покрыть вариативность:

- разные типы горения,

- разная плотность дыма,

- разные погодные условия,

- разные камеры,

- разные фоны,

- разные сценарии ложных срабатываний.

Можно собрать минимальный набор и получить работающую систему, но устойчивость к реальной эксплуатации появляется только при расширении домена. Чем выше требования к надежности, тем дороже данные.

Почему дым — одна из самых сложных задач

Если для дорожного знака или каски еще можно собрать относительно компактный датасет и закрыть большую часть сценариев, то детекция пожара — это задача со звездочкой.

А как отличить туман от дыма? Или пар от дыма? Освещение разное, плотность разная, цвет разный.

Для человека разница очевидна, потому что он учитывает контекст: температуру среды, поведение облака, динамику распространения. Модель лишена этого контекста, она анализирует только визуальные признаки: текстуру, распределение яркости, движение пикселей.

В случае с пожаром нейросеть может быть внимательнее и стабильнее человека: она не устает и анализирует видеопоток круглосуточно. Но ее возможности ограничены самим источником данных. Если система работает только с обычным видеосигналом и не подключена к тепловизорам, датчикам температуры или другим сенсорам, она видит ровно то, что попадает в кадр. Она не чувствует температуры, не ощущает запаха и не «понимает» контекста происходящего — она анализирует только визуальные признаки изображения.

Интернет больше не бесплатный датасет

Во-первых, растет доля контента, созданного самими нейросетями. Это приводит к эффекту замкнутого обучения: модели начинают усиливать артефакты предыдущих генераций.

Во-вторых, ужесточаются требования к происхождению данных. Компании закрывают внутренние знания, а автоматический сбор информации становится юридически чувствительным.

В-третьих, исследования последних лет показывают: после определенного масштаба прирост качества определяется не объемом, а чистотой и релевантностью набора. Дедупликация, фильтрация шума и доменная точность оказываются важнее сырого размера корпуса. Стратегия «Собрать больше» больше не работает.

Синтетика не заменяет реальные данные

Синтетические данные позволяют моделировать редкие сценарии, но они воспроизводят ограничения генератора. Если он систематически искажает текстуры, динамику или распределение шума, модель закрепляет эти артефакты. Именно поэтому лабораторные метрики могут расти, а устойчивость в эксплуатации — нет.

Универсальной нейросети не будет

Видеоаналитика хорошо работает в узких измеримых процессах: подсчет объектов, контроль зон, фиксация конкретных нарушений и другие. Попытка закрыть «всё и сразу» почти всегда превращается в дополнительные издержки для бизнеса в виде усложнения проекта, роста бюджета и нестабильного качества результата.

Все хотят идеальную нейронку, но ИИ-видеоаналитика закрывает только узкие бизнес-процессы. Универсального решения здесь нет — всё настраивается индивидуально, под задачи бизнеса.

Что это значит для 2026 года

В 2026 году выигрывают не те, у кого самая «мощная» модель. Ее сегодня можно купить, дообучить, развернуть. В этом уже нет эксклюзива.

Выигрывают те, кто выстроил процесс работы с данными. Кто понимает, что датасет — это не разовая история «собрали и забыли», а постоянная работа: учитывать сезонность, изменения освещения, смену оборудования, обновлять выборки, дообучать модель.

Кризис датасетов — это не нехватка информации. Информации вокруг много. Проблема в том, что качественных и релевантных данных под конкретную задачу всегда меньше, чем кажется.

Модели становятся совершеннее, но предел прикладного ИИ сегодня проходит не по архитектуре нейросети, а по дисциплине работы с данными. И именно это в ближайшие годы станет главным конкурентным преимуществом.